No dia 4 de outubro a Meta (empresa “dona do Facebook“) criou um novo post em blog que anuncia a criação de uma nova solução de IA generativa para a criação de vídeos, o “Meta Movie Gen”

Prompt: A porcupine wearing a tutu, performing a ballet dance on a stage. (Um porco-espinho vestindo um tutu, realizando uma dança de balé em um palco.)

Prompt: Biker racing through the streets of Los Angeles. Camera tracking shot (Motociclista correndo pelas ruas de Los Angeles. Foto de rastreamento da câmera)

Além da geração de vídeos à partir de um texto, a mesma também propõe a edição de vídeos já existentes (como no exemplo abaixo, onde “Input” é o vídeo inserido)

Esta solução consegue gerar vídeos de 1080p com áudio sincronizado e diferentes aspect ratios à partir de modelos na arquitetura Transfomer com 30 B de parâmetros, com um tamanho máximo contextual de 73K video tokens (o que equivale à, aproximadamente, 16 segundos à 16 FPS). Apesar do tempo não parecer impressionante, gerar um vídeo com tal qualidade através de IA com um nível de detalhismo impressionante como este é um absurdo que pode, futuramente, até auxiliar a indústria dos games.

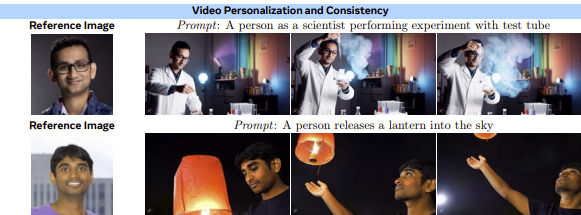

Em muitos casos, como na criação de filmes, vídeos de 16 segundos podem ser suficientes para repor algumas cenas. Note que a solução também traz a capacidade do uso de imagens-referência, como as demonstradas abaixo, para a criação do vídeo

A solução também traz a capacidade de geração de áudio e SFX (efeitos de áudio, usados comumente em filmes). Mas em minha opinião, o som ficou um pouco ruidoso, não sendo comparável à áudios de estúdio.

A solução de geração de áudio (nominada Movie Gen Audio) consiste de 13 B de parâmetros, sendo capaz de gerar áudios à 48kHz. Apesar do que afirmei anteriormente, uma qualidade de áudio destas sem uma edição ou “pós-processamento” feita por um profissional é incrível, então acredito sim que possamos ter usos dela de maneira “imperceptível” em diversas cenas feitas em estúdio.

Segundo o artigo publicado pela Meta, a solução ultrapassa sistemas comerciais como os da disseminada ElevenLabs, que hoje é a maior referência para a comunidade (Basta buscar sobre o assunto no Reddit ou no Discord para perceber isto) e da PikaLabs, que são sistemas comerciais bastante conhecidos na comunidade em geral.

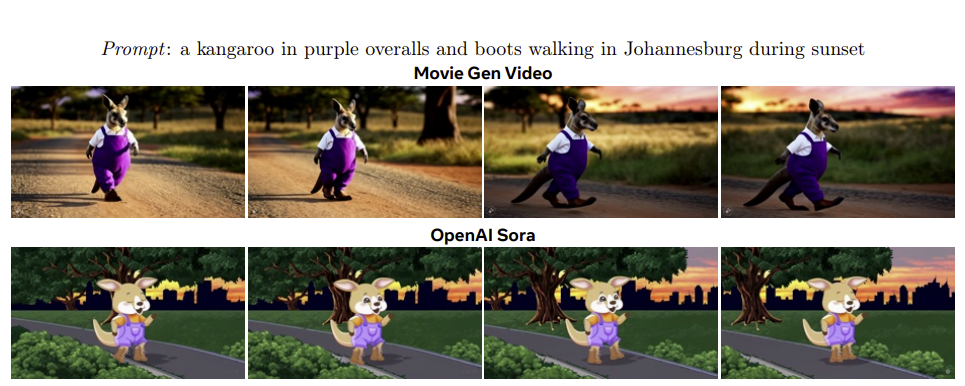

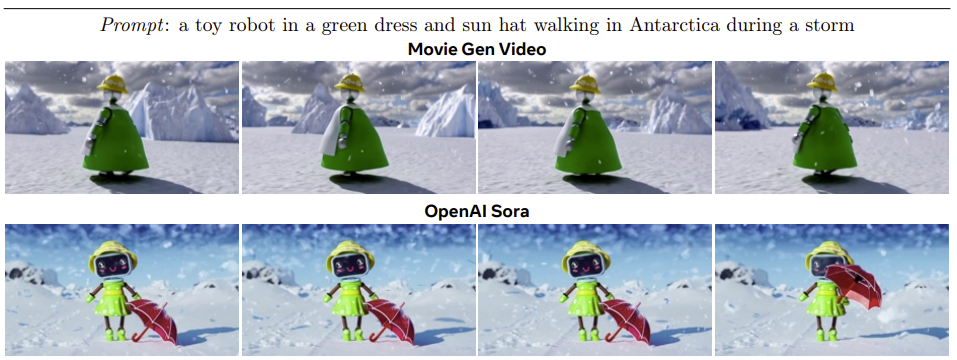

Na comparação acima, com o Sora (usando o mesmo prompt) conseguimos notar e comparar a riqueza de detalhes extras que a nova solução traz.

Para quem gosta de um nível um pouco maior de detalhes, recomendo fortemente que leia o artigo publicado pela Meta. Lá são detalhadas diversas descobertas, assim como todo o processo utilizado (simplificações e similares). Além disto, a meta criou uma playlist para demonstrar um pouco da capacidade do modelo, acesse-a aqui: https://www.youtube.com/playlist?list=PL86eLlsPNfyi27GSizYjinpYxp7gEl5K8

Confesso que estou bastante ansioso para poder “degustar um pouquinho” da solução, mesmo que apenas para hobby/experimentação. E vocês, o que acharam da solução?